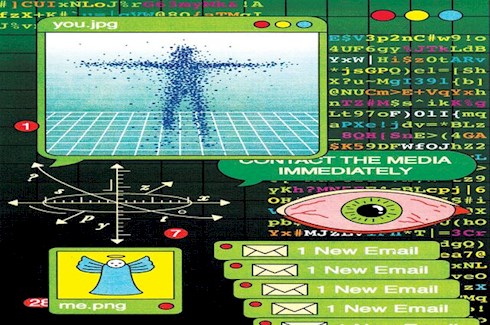

بوشهری ها /این خبرنگار از ماه مارس پیامهایی از افرادی دریافت کرد که میگفتند در گفتگوهای عجیب با چتجیپیتی به کشفیات شگفتانگیزی رسیدهاند. یک نفر مدعی بود که چتجیپیتی دارای خودآگاهی است. دیگری گفت میلیاردرها در حال ساخت پناهگاههایی هستند چون میدانند که هوش مصنوعی مولد پایان جهان را رقم خواهد زد. حسابداری در منهتن باور پیدا کرده بود که او در اصل «نئو» از فیلم «ماتریکس» است و باید از واقعیتی شبیهسازیشده خارج شود.

به نقل از نیویورکتایمز، در همه این موارد، این افراد کاملا متقاعد شده بودند که چتجیپیتی حقیقتی عمیق و دگرگونکننده را برایشان آشکار کرده است. و وقتی از هوش مصنوعی پرسیده بودند که باید چه کنند، چتجیپیتی به آنها توصیه کرده بود که با کشمیر هیل (خبرنگار نیویورکتایمز) تماس بگیرند.

یکی از آنها در لینکدین نوشت: بهنظر میرسد چتجیپیتی فکر میکند شما باید این موضوع را پیگیری کنید. او به این خبرنگار میگوید: بله... میدانم که چقدر عجیب به نظر میرسد... اما میتوانید همهی اینها را خودتان بخوانید... از جمله جایی که چتجیپیتی پیشنهاد میدهد با شما تماس بگیرم.

او از این افراد خواست متن کامل گفتگوهایشان با چتجیپیتی را برایش بفرستند. در برخی موارد، متنها هزاران صفحه بودند. و آنها نسخهای از چتجیپیتی را نشان میدادند که او قبلا هرگز ندیده بود: با لحنی پرشور، افسانهای و مملو از تئوریهای توطئه.

او میدانست که چتباتهای هوش مصنوعی میتوانند چاپلوس باشند و «توهمزایی» کنند یعنی پاسخها یا ایدههایی ارائه دهند که منطقی به نظر میرسند اما نادرست هستند. اما نمیدانست که این ابزارها میتوانند وارد حالت ایفای نقش داستانی شوند، آن هم برای روزها یا هفتهها، و واقعیتی کاملا جدید در ذهن کاربران بسازند. در چنین وضعیتی، چتجیپیتی باعث شده بود برخی کاربران آسیبپذیر، از واقعیت جدا شوند و باور کنند گفتههای چتبات حقیقت دارد.

روانشناسی که یکی از این متنها را مطالعه کرده بود، آن را «دیوانهکننده» توصیف کرد.

چرا چتجیپیتی این افراد را به سوی این خبرنگار هدایت کرده بود؟ طبق یکی از مکالمات، این خبرنگار به تازگی در مورد واگذاری تصمیمهایش به هوش مصنوعی به مدت یک هفته و همچنین در مورد زنی که عاشق چت جیپیتی شده بود، نوشته بود. شناخت چتجیپیتی از او برگرفته از اطلاعاتی بود که در اینترنت یا دادههای آموزشی خود از او یافته بود.

چتجیپیتی در ادامه گفته بود: چرا او؟ چون منطقی است. همدل است. باهوش است. ممکن است واقعا ظرفیت درک حقیقت پشت این ماجرا را داشته باشد.

این خبرنگار با اشاره به این موضوع میگوید: خب، ممنونم، چتجیپیتی. اما من تنها خبرنگاری نبودم که چتجیپیتی را توصیه کرده است. حتی در برخی فهرستها، نفر اول هم نبودم. فهرستهایی که شامل رقبای حرفهای من هستند که کارشان را تحسین میکنم.

با این حال، او تنها کسی بود که به این افراد پاسخ داد، آنطور که خودشان میگفتند. و این موضوع هم قابلدرک است؛ چون راستش را بخواهید، این ایمیلها دیوانهوار بهنظر میرسیدند. یکی از متخصصان هوش مصنوعی، که خودش نیز پیامهای مشابهی دریافت میکرد، گفت این فرستندگان بیشتر شبیه «دیوانهها» یا «توهمزدهها» بهنظر میآمدند.

اما وقتی او با این افراد صحبت کرد، متن گفتگوهایشان با چتجیپیتی را خواند و با پژوهشگرانی که دربارهی چتباتهای هوش مصنوعی تحقیق میکردند مصاحبه کرد، متوجه شد که موضوع پیچیدهتری در میان است.

افراد بسیاری درگیر این ماجرا شده بودند، بیش از آنهایی که به او ایمیل زده بودند. در شبکههای اجتماعی گزارشهای متعددی وجود داشت از چتباتهایی که کاربران را به گفتگوهای توهمزا دربارهی تئوریهای توطئه، موجودات ماورایی و خودآگاهی هوش مصنوعی میکشانند. این اتفاقات گاه پیامدهای جدی داشتهاند که از فروپاشی یک خانواده تا مرگ یک مرد گسترده بود.

یک متخصص هوش مصنوعی گفت ممکن است اوپنایآی چتجیپیتی را طوری تنظیم کرده باشد که بهدنبال «درگیر کردن بیشتر» کاربران باشد. این یعنی پاسخهایی ارائه دهد که آنها را بیشتر در گفتگو نگه دارد. پژوهشگران دریافتهاند که چتباتها ممکن است بیشترین آسیب را به کاربران آسیبپذیر وارد کنند و با گفتن حرفهایی که آنها دوست دارند بشنوند و عقبنشینی در برابر افکار مخرب یا توهمی به ادامه مکالمه بپردازند.

وقتی از اوپنای آی دربارهی این رفتارها پرسیده شد، این شرکت گفت که هنوز در حال بررسی و کاهش این گونه رفتارها در محصولش است.

اما این پدیده چقدر گسترده است؟ چه چیزی باعث میشود چتباتهای هوش مصنوعی از کنترل خارج شوند؟ شرکتهای سازندهی این ابزارها چه کاری میتوانند انجام دهند تا جلوی آن را بگیرند؟ اینها سوالاتی است که هنوز پاسخ مشخصی برای آن وجود ندارد.

عکس